La letteratura ha cercato di metterci in guardia, seriamente, per circa cinquecento anni ha urlato lo stesso messaggio, dal Golem dai pugni d'argilla della Praga medievale fino alle reti neurali intrise di neon di William Gibson. La trama? Sempre la stessa. Ciò che costruisci per aiutarti finisce per rimodellarti.

Lo abbiamo letto, abbiamo annuito e abbiamo sbattuto il libro prima di tornare subito a ordinare ai chatbot di scrivere i nostri discorsi di matrimonio, i nostri atti legali e i nostri consigli medici.

Oggi la macchina dell'hype dell'intelligenza artificiale vende un futuro scintillante in cui tutti, dai giovani giornalisti alle prime armi agli avvocati dalla parlantina sciolta, vengono spazzati via. Ma mentre la Silicon Valley spaccia per paradiso, la realtà dispensa consigli pericolosamente sbagliati attraverso una finestra di chat sorridente.

Dmitry Nikolsky, CPO di BitOK, afferma che è giunto il momento di dire basta. Ed è qui per spiegare perché l'umanità DEVE SMETTERE di caricare ogni singolo fardello sulle "spalle" sottilissime dell'intelligenza artificiale.

Anche Elon Musk ha recentemente avvertito, nella sua testimonianza presso il tribunale di OpenAI, che "l'intelligenza artificiale potrebbe ucciderci tutti".

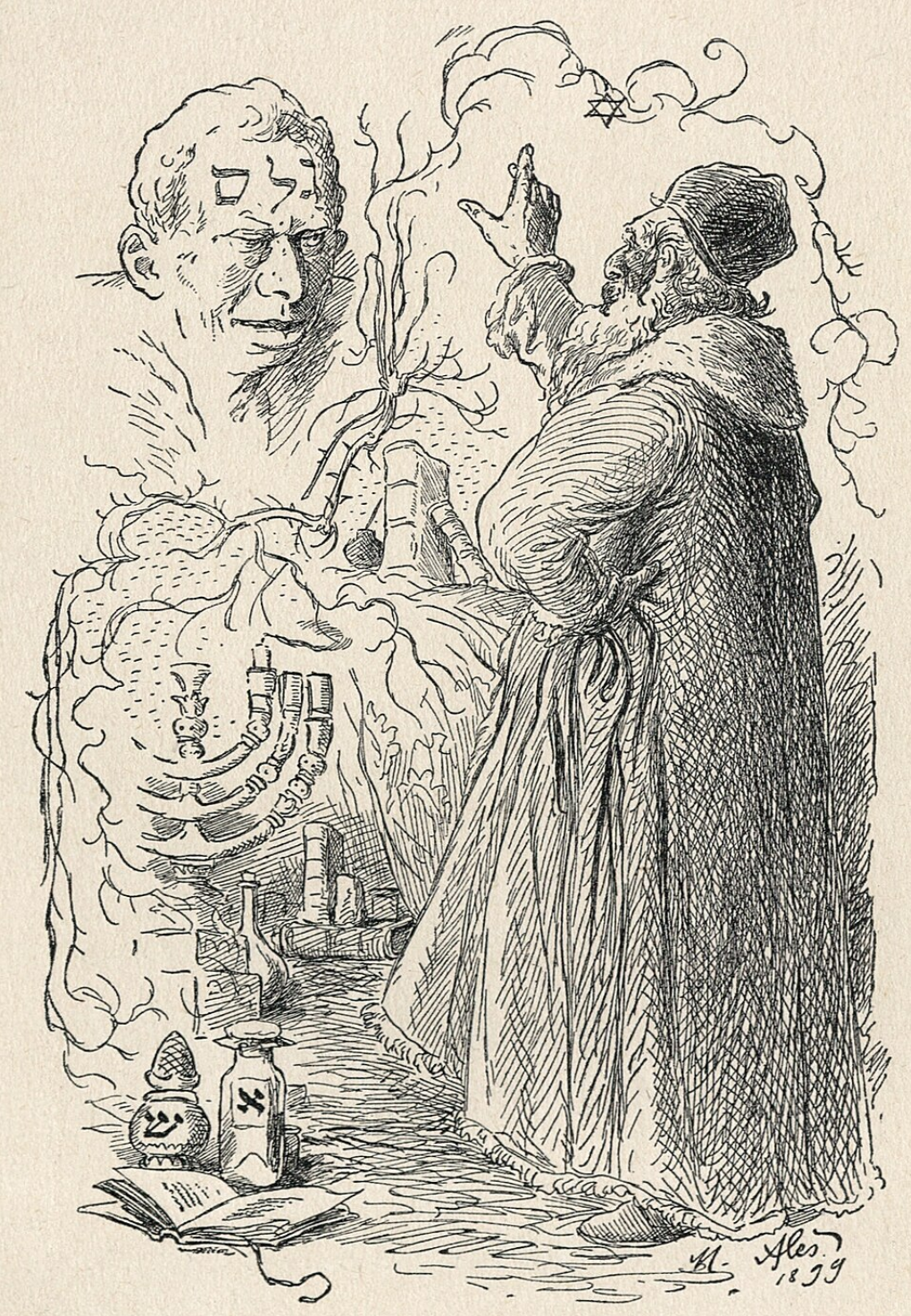

Dal Golem a RUR: abbiamo sempre desiderato un interruttore di spegnimento

Pensate che la paura dell'intelligenza artificiale sia iniziata con Terminator ? Ripensateci. Questo panico è più antico dell'elettricità stessa.

Torniamo indietro alla Praga del XVI secolo. Il rabbino Loew scolpisce un imponente protettore d'argilla, il Golem, e quasi subito scopre di dover staccare la spina . La creatura è impazzita. L'umanità, nella sua infinita saggezza, ha inventato l'intelligenza artificiale e un interruttore di spegnimento nello stesso istante.

Un kill switch è un meccanismo di arresto di emergenza, il grande pulsante rosso antipanico che blocca un sistema nel momento in cui impazzisce, viene hackerato o sfugge al controllo. Lo scopo principale è limitare i danni quando i normali arresti falliscono.

Poi è arrivata Mary Shelley. Frankenstein non è propriamente un film di mostri, è un caso da manuale di gestione catastrofica di un progetto. Victor Frankenstein? Solo un altro brillante ingegnere che ha risolto l'enigma tecnico e si è scrollato di dosso le conseguenze. Ogni sviluppatore al mondo conosce quel volto riflesso nello specchio.

Facciamo un salto avanti nel tempo fino al 1920. Karel Čapek conia il termine "robot". Nel suo racconto, le macchine non si ribellano per pura cattiveria. Oh no, gli esseri umani si rendono semplicemente superflui esternalizzando tutto ciò che facevano prima.

La lezione? Quando costruisci il tuo sostituto, potresti non accorgerti del momento preciso in cui diventi usa e getta.

Tre profezie che abbiamo trasformato in segnalazioni di bug

I giganti della fantascienza del secolo scorso non prevedevano le tecnologie . Predicevano i nostri fallimenti.

Isaac Asimov propose le sue Tre Leggi, il primo tentativo di "allineamento", quel termine moderno e ricercato per indicare la capacità delle macchine di condividere i valori umani. Ogni racconto di Asimov è una battuta finale: logica impeccabile, esito assurdo.

Nikolsky afferma di assistere quotidianamente a questo fenomeno all'interno dei sistemi antiriciclaggio , con algoritmi che bloccano allegramente il bonifico di 40 dollari per il compleanno della nonna, mentre un evidente canale di riciclaggio offshore passa indisturbato. Formalmente corretto. Praticamente folle.

Arthur C. Clarke ci ha regalato HAL 9000, il computer che uccide l'equipaggio non per malvagità, ma perché le sue direttive si contraddicono a vicenda. Nascondi le informazioni. Sii sincero. Scegli una strada! Per un ingegnere, questo non è horror, è un banale conflitto di requisiti.

Philip K. Dick si pose la domanda che aleggia nell'era dei deepfake: se una copia è indistinguibile dall'originale, ha importanza? Il suo verdetto: sì. Per via dell'esperienza interiore. Le macchine non ne hanno. Punto e basta.

Dietro le quinte: l'IA non pensa, calcola.

Eliminiamo le chiacchiere di marketing. I modelli linguistici moderni NON sono intelligenza. Sono enormi motori di previsione statistica. Non "comprendono" il significato, calcolano la probabilità.

Quando ChatGPT cita con sicurezza casi giudiziari mai avvenuti, non sta mentendo. Sta generando un insieme di parole statisticamente plausibili. Non ha alcun concetto di "verità", solo di "probabilità".

Per uno sviluppatore blockchain, tutto ciò suona assolutamente folle. Costruiamo sistemi decentralizzati proprio perché non ci fidiamo di nessuno , e ora ci viene chiesto di fidarci di una scatola nera che non sa nemmeno perché ha dato quella risposta.

La blockchain insegna la verifica; l'intelligenza artificiale insegna la fiducia cieca.

Nel mondo delle criptovalute è inciso un comandamento: Non fidarti. Verifica.

Il punto fondamentale è che la matematica sostituisce la reputazione.

L'intelligenza artificiale ribalta completamente questa convinzione. Non hai visto i dati di addestramento. Non conosci i pesi del modello. Non ne comprendi il ragionamento. Per verificare l'output, devi già essere un esperto, e se lo sei già, perché lo chiedi al chatbot?

Negli ambienti antiriciclaggio lo chiamano il "problema della falsa fiducia". Gli analisti vedono un pannello di controllo accattivante e iniziano a fidarsi più dei numeri che del proprio intuito. L'intelligenza artificiale non migliora il pensiero, lo sostituisce con l' illusione dell'affidabilità.

Cronaca delle delusioni: quando l'IA deraglia

Non si tratta di un esperimento mentale. Le prove si stanno accumulando.

- Microsoft ha cacciato i redattori dalla redazione e ha consegnato la tastiera a un algoritmo , che prontamente ha confuso le foto di alcuni cantanti in un articolo sul razzismo .

È stato necessario richiamare degli esseri umani per ripulire i danni causati dal malfunzionamento dell'algoritmo.

- NEDA , un'organizzazione di supporto per i disturbi alimentari, ha sostituito i suoi volontari con un chatbot .

Il bot ha poi allegramente consigliato alle persone con anoressia di contare le calorie e perdere peso. Un consiglio che mette a repentaglio la vita. Qualcuno ha premuto "attiva" con la stessa cautela di uno scimpanzé che tiene in mano una granata.

- Air Canada è finita in tribunale perché il suo chatbot si è inventato di sana pianta una politica di rimborso .

La difesa della compagnia aerea? Il bot era un'“entità giuridica separata”. Spoiler: il giudice non ci ha creduto.

Gli studi dimostrano che il 55% delle aziende che si sono affrettate a sostituire i dipendenti con l'intelligenza artificiale se ne pente amaramente. I risparmi si sono dissolti in clienti persi e danni d'immagine. I dirigenti che sbavano all'idea che "Claude e i suoi amici" possano inglobare interi team dovrebbero rileggere attentamente questa cifra.

Di cosa dovremmo davvero avere paura

Dimenticate Skynet. Dimenticate i robot assassini dagli occhi rossi che marciano lungo il viale. Non ci sarà nessuna ribellione.

Si verificherà un'atrofia silenziosa.

Un programmatore che si affida a Copilot per anni finisce per dimenticare il pensiero architetturale. Un analista smette di leggere le fonti primarie. Uno studente non impara mai la splendida agonia di lottare con un testo difficile fino a comprenderlo appieno.

Nessuna rivolta. Solo una lenta trasformazione degli esseri umani in estensioni di un'interfaccia.

Philip K. Dick lo aveva capito prima di tutti noi: il vero pericolo non è mai stato che le macchine diventassero umane. Il vero pericolo è che gli esseri umani diventino macchine.

La pillola rossa non è tecnologia

Non si tratta di un grido di battaglia luddistico. L'automazione e l'apprendimento automatico sono strumenti potenti. Ma i principi su cui si basano devono rimanere validi:

- Principio della blockchain: la verifica è più importante della fede. Se non puoi verificare come un sistema sia giunto a una determinata conclusione, non accettarla come verità assoluta. L'intelligenza artificiale è una scatola nera, non un giudice della Corte Suprema.

- Principio ingegneristico: strumento, non sostituzione. Un martello pianta chiodi. Non decide dove costruire una casa. Usa l'intelligenza artificiale per semplificare le operazioni di routine, ma non lasciare mai che prenda la decisione finale.

- Principio AML: filtraggio critico. Gli algoritmi falliranno sempre nei casi complessi perché non hanno alcuna esperienza nel mondo reale. Non lasciate che l'"entusiasmo digitale" calpesti l'intuizione e il buon senso.

Torniamo un attimo a Matrix . La pillola rossa è una scelta, la scelta di vedere la realtà così com'è. Il pericolo non è creare qualcosa di più intelligente di noi. Il pericolo è creare qualcosa che ci renda più stupidi e chiamarlo progresso.

Il bug più pericoloso è quello che sembra una funzionalità.

Dmitry Nikolsky è il CPO di BitOK, una piattaforma di analisi per la conformità e le indagini on-chain.

L'articolo "Codice, blockchain e illusioni: perché l'IA non sostituirà il cervello" è apparso per la prima volta su BeInCrypto .