La società di analisi blockchain Elliptic ha recentemente pubblicato un rapporto completo intitolato "Lo stato del crimine crittografico abilitato all'intelligenza artificiale: tipologie e tendenze emergenti a cui prestare attenzione". Questo rapporto fa luce sull’allarmante aumento dell’intelligenza artificiale (AI) per facilitare vari crimini legati alle criptovalute.

Sebbene l’intelligenza artificiale abbia rappresentato un punto di svolta per molti settori, il suo uso improprio nelle criptovalute sta diventando una preoccupazione significativa.

Come l'intelligenza artificiale sta trasformando il crimine crittografico: gli approfondimenti di Elliptic

Il rapporto di Elliptic identifica cinque tipologie principali di sfruttamento dell'intelligenza artificiale nei crimini legati alle criptovalute. Il primo e forse il più noto è l’uso di deepfake generati dall’intelligenza artificiale. Spesso i truffatori utilizzano immagini o video falsi con personaggi pubblici per creare truffe convincenti.

Ad esempio, i truffatori hanno utilizzato deepfake di personaggi come Elon Musk e l’ex primo ministro di Singapore Lee Hsien Loong per promuovere programmi di investimento fraudolenti. I truffatori distribuiscono questi deepfake su piattaforme di social media come TikTok e X.com, ingannando gli investitori ignari. Per combattere queste truffe, Elliptic consiglia di cercare specifici segnali d'allarme.

Per saperne di più: In che modo l'intelligenza artificiale (AI) trasformerà le criptovalute?

“Esistono, fortunatamente, una serie di indicatori di allarme che possono aiutarti a evitare di cadere vittima di truffe deepfake. Per verificare l'autenticità del video, puoi controllare se i movimenti delle labbra e le voci si sincronizzano, assicurarti che le ombre appaiano dove ti aspetti e controlla che l'attività facciale come sbattere le palpebre sembri naturale", ha osservato Elliptic.

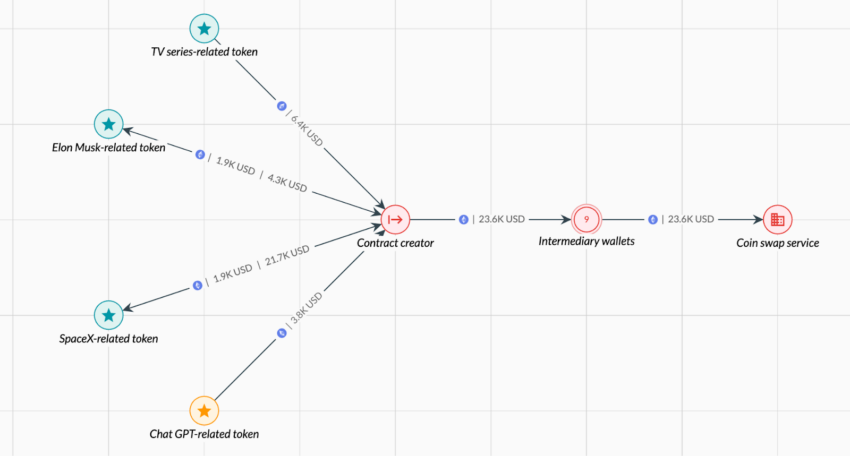

Un altro crimine diffuso facilitato dall’intelligenza artificiale è la creazione di token truffa . Su molte blockchain, è relativamente facile creare un nuovo token, che i truffatori sfruttano per generare clamore e gonfiare artificialmente i prezzi prima di eseguire uno schema di "rug-pull" o "pump-and-dump".

I token con nomi che fanno riferimento all'intelligenza artificiale, come "GPT", sono stati obiettivi particolarmente popolari. L'indagine di Elliptic ha rivelato numerose truffe di uscita che coinvolgono tali token, sottolineando la necessità di vigilanza negli investimenti in token.

I criminali informatici hanno anche cooptato modelli linguistici di grandi dimensioni come ChatGPT per supportare le loro attività illecite. Questi strumenti di intelligenza artificiale possono generare nuovo codice o verificare codice esistente, che può essere utilizzato in modo improprio per identificare e sfruttare le vulnerabilità.

Sebbene aziende come Microsoft e OpenAI abbiano segnalato usi dannosi da parte di attori statali provenienti da Russia e Corea del Nord, la tecnologia deve ancora raggiungere un punto in cui possa facilitare costantemente attacchi informatici di successo. Tuttavia, l’emergere di strumenti di intelligenza artificiale non etici come HackedGPT e WormGPT sui forum del dark web rappresenta una minaccia significativa, offrendo servizi di phishing, creazione di malware e hacking.

L'intersezione tra intelligenza artificiale e criptovalute: opportunità e minacce svelate

Un’altra area in cui l’intelligenza artificiale sta avendo un impatto è l’automazione della distribuzione delle truffe. Alcune operazioni di truffa prevedono la creazione di investimenti falsi, lanci aerei o siti di omaggi ampiamente promossi attraverso i social media e le app di messaggistica.

Una volta esposti, questi siti vengono abbandonati e il processo ricomincia da capo con nuovi siti e marketing. L’intelligenza artificiale viene utilizzata per semplificare questo processo ciclico, rendendolo più efficiente e più difficile da tracciare.

Il furto di identità e la creazione di documenti falsi sono da tempo elementi fondamentali del dark web. Ora, alcuni servizi stanno incorporando l’intelligenza artificiale per ampliare le proprie operazioni. Ad esempio, un servizio di rendering di documenti pubblicizzato utilizza l’intelligenza artificiale per produrre documenti d’identità e passaporti falsi di alta qualità.

"Elliptic ha identificato un indirizzo crittografico utilizzato per i pagamenti a questo servizio, che ha ricevuto pagamenti sufficienti per generare poco meno di 5.000 documenti falsi nell'arco di un mese", ha aggiunto l'azienda.

A gennaio, la Commodity Futures Trading Commission (CFTC) ha emesso un avviso ai consumatori sulle truffe alimentate dall’intelligenza artificiale. L'agenzia ha messo in guardia sui programmi che promettono rendimenti massicci attraverso algoritmi di arbitraggio crittografico e altre tecnologie assistite dall'intelligenza artificiale.

La CFTC ha sottolineato che i truffatori spesso fanno false promesse di rapidi profitti, sfruttando la fascinazione del pubblico per l'intelligenza artificiale. Una truffa degna di nota ha comportato la perdita di 30.000 Bitcoin (BTC), valutati all'epoca a circa 1,7 miliardi di dollari.

Per saperne di più: L'intelligenza artificiale nella finanza: gli 8 principali casi d'uso dell'intelligenza artificiale per il 2024

In effetti, l’intersezione tra intelligenza artificiale e criptovaluta presenta sia immense opportunità che sfide significative. Sebbene l’intelligenza artificiale possa migliorare la sicurezza e l’efficienza delle criptovalute, il suo potenziale di abuso evidenzia la necessità di una risposta ben pianificata e informata. Comprendendo queste nuove tendenze, le parti interessate possono proteggere meglio l’ecosistema crittografico dall’evoluzione delle tattiche criminali.

Il post Le 5 principali nuove tendenze nel crimine crittografico abilitato all'intelligenza artificiale: il rapporto di Elliptic è apparso per la prima volta su BeInCrypto .