I paesi industriali del Gruppo dei Sette (G7) sono pronti a stabilire un “Codice di condotta” volontario per le aziende che innovano nel campo dei sistemi avanzati di intelligenza artificiale (AI). Questa iniziativa, derivante dal “processo AI di Hiroshima”, cerca di affrontare il potenziale uso improprio e i rischi associati a questa tecnologia trasformativa.

Il G7, che comprende Canada, Francia, Germania, Italia, Giappone, Gran Bretagna e Stati Uniti, insieme all’Unione Europea, ha avviato questo processo per creare un precedente per la governance dell’IA.

Le nazioni del G7 presentano un codice di condotta globale sull’intelligenza artificiale

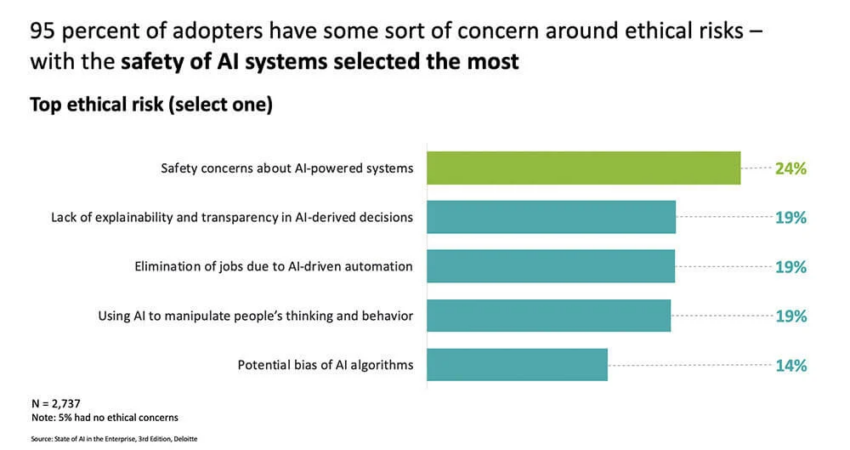

In mezzo alle crescenti preoccupazioni sulla privacy e ai rischi per la sicurezza, il codice in 11 punti è un faro di speranza. Secondo un documento del G7, il codice di condotta,

“Mira a promuovere un’intelligenza artificiale sicura, protetta e affidabile in tutto il mondo e fornirà una guida volontaria per le azioni delle organizzazioni che sviluppano i sistemi di intelligenza artificiale più avanzati”.

Il codice incoraggia le aziende a identificare, valutare e mitigare i rischi durante tutto il ciclo di vita dell’intelligenza artificiale. Inoltre, raccomanda di pubblicare rapporti pubblici sulle capacità, le limitazioni e l’utilizzo dell’intelligenza artificiale, sottolineando robusti controlli di sicurezza .

Per saperne di più: I 6 lavori più interessanti nel campo dell'intelligenza artificiale (AI) nel 2023

Il capo digitale della Commissione europea Vera Jourova, in un forum sulla governance di Internet, ha dichiarato:

"Un codice di condotta rappresentava una base solida per garantire la sicurezza e fungeva da ponte fino all'entrata in vigore della regolamentazione."

OpenAI si unisce alla causa

OpenAI, la società madre di ChatGPT, ha anche formato un team di preparazione per gestire i rischi posti dai modelli di intelligenza artificiale . Guidato da Aleksander Madry, il team affronterà rischi quali la persuasione individualizzata, le minacce alla sicurezza informatica e la propagazione della disinformazione.

Questa mossa è il contributo di OpenAI al prossimo vertice globale sull’IA del Regno Unito, facendo eco alla richiesta globale di sicurezza e trasparenza nello sviluppo dell’IA.

Il governo del Regno Unito definisce Frontier AI come :

"Modelli di intelligenza artificiale generica altamente capaci in grado di eseguire un'ampia varietà di compiti e di eguagliare o superare le capacità presenti nei modelli più avanzati di oggi."

Il team di preparazione di OpenAI si concentrerà sulla gestione dei rischi, consolidando ulteriormente la necessità di un “Codice di condotta” globale sull’intelligenza artificiale.

Mentre l’intelligenza artificiale continua ad evolversi, l’atteggiamento proattivo del G7 e l’impegno di OpenAI per la mitigazione del rischio rappresentano risposte tempestive. Il "codice di condotta" volontario e la formazione di un gruppo di preparazione dedicato rappresentano passi significativi verso lo sfruttamento responsabile della potenza dell'intelligenza artificiale. L’obiettivo è garantire che i suoi benefici siano massimizzati mentre i potenziali rischi siano gestiti in modo efficace.

Disclaimer

In aderenza alle linee guida del Trust Project, BeInCrypto si impegna a fornire rapporti imparziali e trasparenti. Questo articolo di notizie mira a fornire informazioni accurate e tempestive. Tuttavia, si consiglia ai lettori di verificare i fatti in modo indipendente e di consultare un professionista prima di prendere qualsiasi decisione basata su questo contenuto.

Questo articolo è stato inizialmente compilato da un'intelligenza artificiale avanzata, progettata per estrarre, analizzare e organizzare informazioni da un'ampia gamma di fonti. Funziona senza convinzioni, emozioni o pregiudizi personali, fornendo contenuti incentrati sui dati. Per garantirne la pertinenza, l'accuratezza e l'aderenza agli standard editoriali di BeInCrypto, un editore umano ha esaminato, modificato e approvato meticolosamente l'articolo per la pubblicazione.

I paesi post G7 promuovono il "Codice di condotta" dell'intelligenza artificiale per prevenire l'uso improprio della tecnologia è apparso per la prima volta su BeInCrypto .