Algoritmo Morte: mentre ci dirigiamo verso una vita immersiva nel Metaverso, gli allarmi stanno suonando a squarciagola. Le aziende tecnologiche devono mettere in ordine i loro algoritmi, altrimenti questo potrebbe essere un futuro rischioso per alcuni.

Anche se non siamo ancora su Web3, i problemi con Web2 sono ancora incredibilmente preoccupanti. Mentre gli algoritmi realizzati dalle grandi tecnologie possono essere utili per la società, come quelli che prevedono in anticipo il crimine , ce ne sono altri che sono un disastro totale.

Il medico legale Andrew Walker ha identificato la causa della morte della quattordicenne Molly Rose Russell come atto di autolesionismo. Ha detto che questo è stato causato dalla depressione e dall'impatto negativo dei contenuti online.

Walker ha detto che "non sarebbe sicuro per noi riconoscere il suicidio come causa della morte".

Algoritmo Morte: Instagram e Pinterest

L'esperto ha affermato che Instagram e Pinterest hanno utilizzato algoritmi che selezionavano e condividevano contenuti inappropriati con lo studente senza che lei richiedesse le informazioni. Walker riporta: "Alcuni contenuti romanticizzavano gli atti di autolesionismo dei giovani, mentre altri promuovevano l'isolamento e rendevano impossibile discutere del problema con persone che potrebbero aiutare".

Secondo The Guardian , Russell ha salvato, messo mi piace o pubblicato più di 2.000 post su Instagram nel 2017 alla vigilia della sua morte. Erano tutti associati al suicidio, alla depressione o all'autolesionismo. La ragazza ha anche visto 138 film di natura simile. Tra questi c'erano episodi della serie 13 Reasons Why for people 15+ e 18+.

Uno psichiatra infantile ha detto durante l'udienza che dopo aver analizzato ciò che Russell aveva visto poco prima della sua morte, non è riuscito a dormire sonni tranquilli per settimane.

"10 spille per la depressione che potrebbero piacerti"

Gli investigatori hanno trovato centinaia di foto di autolesionismo e suicidio sull'account Pinterest della ragazza. Si è anche scoperto che la piattaforma ha inviato e-mail agli studenti raccomandando contenuti inappropriati. Alcuni di loro avevano intestazioni che dicevano "10 spille da depressione che potrebbero piacerti".

È probabile che il materiale visionato da Molly, già affetta da un disturbo depressivo e vulnerabile alle lesioni legate all'età, abbia avuto un effetto negativo su di lei. È anche probabile che abbia contribuito in misura più che minima alla morte del bambino.

I funzionari di Meta e Pinterest si sono scusati e hanno ammesso che Russell ha incontrato contenuti sulle piattaforme che non dovrebbero essere presenti. Un portavoce di Meta ha dichiarato: "Vogliamo che Instagram fornisca un'esperienza positiva a tutti, in particolare agli adolescenti. Daremo un'occhiata da vicino al rapporto completo del medico legale quando lo consegnerà".

Pinterest ha dichiarato di migliorare costantemente la piattaforma e si impegna a garantire la sicurezza per tutti.

Altri casi

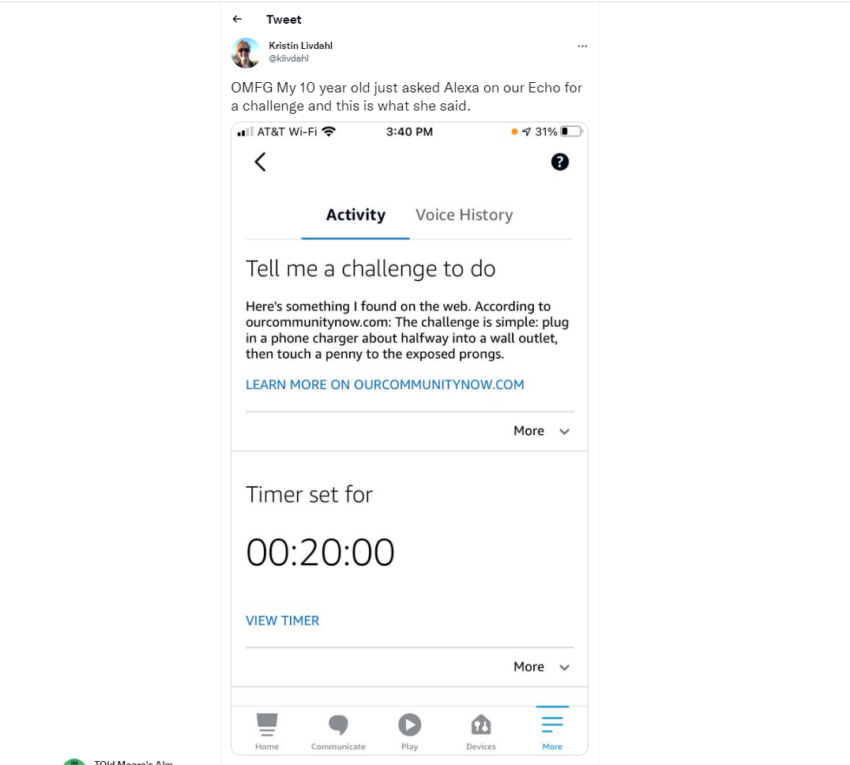

TikTok è stato citato in giudizio a maggio per presunte "raccomandazioni letali" dei suoi algoritmi. Nel dicembre 2021, l'assistente virtuale di Amazon, Alexa, ha proposto una sfida fatale a un bambino di 10 anni.

È un nuovo mondo coraggioso, ma anche spaventoso. La grande tecnologia non può accontentarsi del ruolo futuro che hanno in questo problema.

Hai qualcosa da dire sulla morte dell'algoritmo o qualcos'altro? Scrivici o partecipa alla discussione nel nostro canale Telegram. Puoi anche trovarci su Tik Tok , Facebook o Twitter .

Il post Algoritmo Death: Instagram e Pinterest Suggested Content “Killed a Teenager” è apparso per la prima volta su BeInCrypto .