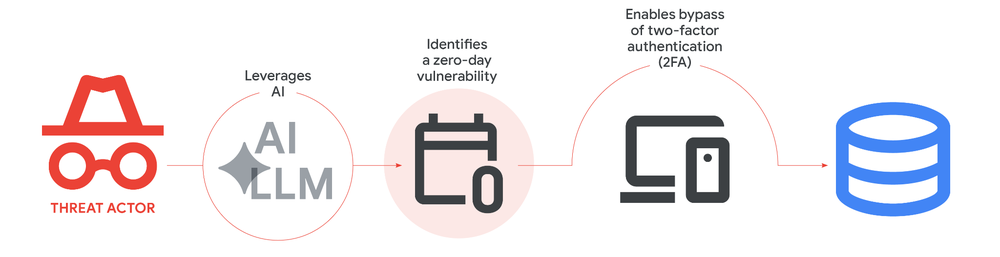

Il gruppo Threat Intelligence di Google ha dichiarato domenica di aver individuato quello che ritiene essere il primo exploit zero-day creato con l'aiuto di un modello di intelligenza artificiale.

Secondo un rapporto pubblicato da Google sul suo Cloud Blog, un gruppo di hacker criminali ha scritto uno script Python per aggirare l'autenticazione a due fattori (2FA) in uno strumento di amministrazione web open source. L'azienda ha collaborato con il fornitore per impedire che la vulnerabilità venisse sfruttata su larga scala.

Google ha collegato la falla all'intelligenza artificiale tramite modelli di codice.

Google non ha attribuito la colpa al proprio modello Gemini. Gli analisti hanno evidenziato schemi strutturali nel codice che suggeriscono fortemente il coinvolgimento dell'intelligenza artificiale.

"In base alla struttura e al contenuto di questi exploit, siamo molto fiduciosi che l'autore abbia probabilmente sfruttato un modello di intelligenza artificiale per supportare la scoperta e l'utilizzo a fini malevoli di questa vulnerabilità", ha scritto Google.

Lo script Python presentava docstring didattiche insolitamente dettagliate, un punteggio di gravità CVSS allucinatorio e una formattazione tipica dell'output di un modello linguistico di grandi dimensioni.

Ciò include menu di aiuto strutturati e una classe di colori chiara, scritta in stile manuale.

Google non ha rivelato il nome del gruppo di hacker né lo strumento specifico preso di mira.

Hacker finanziati dallo Stato utilizzano modelli di intelligenza artificiale per la ricerca di vulnerabilità.

Il rapporto di Google va oltre il singolo caso zero-day.

Secondo il Threat Intelligence Group di Google, gli hacker legati alla Cina e alla Corea del Nord hanno mostrato un forte interesse nell'utilizzo dell'intelligenza artificiale per individuare e sfruttare le vulnerabilità del software.

Un gruppo di hacker cinese noto come UNC2814 attacca obiettivi nel settore delle telecomunicazioni e governativi. Il gruppo ha utilizzato una tecnica che Google chiama "jailbreaking basato sulla persona".

Il gruppo ha istruito un modello di intelligenza artificiale a comportarsi come un revisore senior della sicurezza, per poi incaricarlo di analizzare il firmware dei dispositivi embedded di TP-Link e le implementazioni del protocollo Odette File Transfer Protocol alla ricerca di vulnerabilità di esecuzione di codice in remoto.

Il gruppo ha incaricato un modello di intelligenza artificiale di agire come revisore senior della sicurezza, per poi incaricarlo di ricercare vulnerabilità di esecuzione di codice in remoto nel firmware dei dispositivi embedded di TP-Link e nelle implementazioni del protocollo Odette File Transfer Protocol.

Un altro gruppo, con legami con la Cina, ha utilizzato strumenti chiamati Strix e Hexstrike per attaccare un'azienda tecnologica giapponese e una delle principali società di sicurezza informatica dell'Asia orientale.

Il gruppo nordcoreano APT45 ha adottato un approccio diverso. Ha inviato migliaia di richieste ripetitive per analizzare in modo ricorsivo le voci CVE note e convalidare gli exploit proof-of-concept.

Google ha affermato che questo metodo ha prodotto "un arsenale più robusto di capacità di sfruttamento delle vulnerabilità, che sarebbe impraticabile da gestire senza l'ausilio dell'intelligenza artificiale".

L'intelligenza artificiale consente nuove forme di malware e di elusione

Il rapporto di Google affronta altre minacce legate all'intelligenza artificiale, oltre alla ricerca sulle vulnerabilità.

Presunti hacker russi avrebbero utilizzato l'intelligenza artificiale per programmare e costruire malware polimorfici e reti di offuscamento. Questo tipo di malware accelera i cicli di sviluppo e li aiuta a eludere il rilevamento.

Google ha inoltre messo in guardia contro un tipo di malware chiamato PROMPTSPY, descritto come un'evoluzione verso operazioni di attacco autonome. Il malware utilizza modelli di intelligenza artificiale per interpretare lo stato del sistema e generare dinamicamente comandi per manipolare l'ambiente della vittima. Gli aggressori possono delegare le decisioni operative al modello stesso.

Gli autori delle minacce si procurano ora un accesso anonimo di livello premium ai modelli linguistici tramite middleware specializzati e sistemi automatizzati di registrazione degli account. Questi servizi consentono agli hacker di aggirare in massa le restrizioni d'uso utilizzando account di prova per finanziare le proprie attività.

Un gruppo monitorato da Google con il nome di TeamPCP, noto anche come UNC6780, ha iniziato a prendere di mira le dipendenze dei software di intelligenza artificiale come punto di ingresso in reti più ampie. Utilizzano strumenti di intelligenza artificiale compromessi come base per la diffusione di ransomware e per estorcere denaro.

Google ha affermato di utilizzare i propri strumenti di intelligenza artificiale a scopo difensivo. L'azienda ha citato Big Sleep, un agente di intelligenza artificiale che identifica le vulnerabilità del software, e CodeMender, che utilizza il ragionamento di Gemini per correggere automaticamente i difetti.

Google ha inoltre affermato di disabilitare gli account che utilizzano Gemini in modo improprio per scopi dannosi.

Non limitarti a leggere le notizie sulle criptovalute. Cerca di capirle. Iscriviti alla nostra newsletter. È gratis .